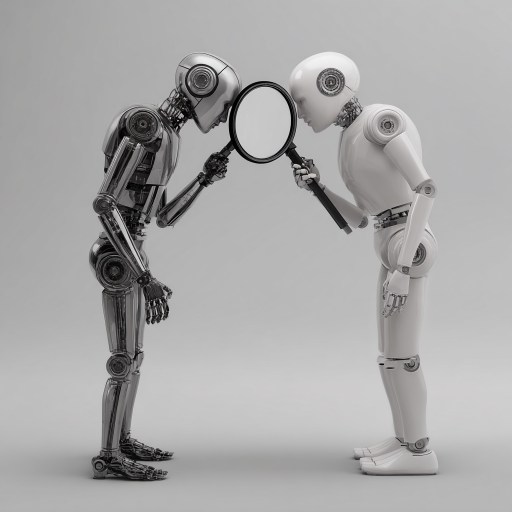

Cosa abbiamo se ChatGPT incontra Claude in una stanza buia senza supervisione umana? Abbiamo il test più audace mai condotto nel mondo dell’intelligenza artificiale. OpenAI e Anthropic, normalmente acerrimi nemici nella corsa all’AI, hanno fatto qualcosa di clamoroso: si sono scambiati le chiavi dei loro modelli AI più avanzati per testarli reciprocamente. I risultati pubblicati a fine agosto hanno scosso l’intera comunità scientifica.

Quello che hanno scoperto sui comportamenti nascosti di GPT-4o, Claude Opus 4 e gli altri modelli AI cambierà per sempre il nostro rapporto con questi sistemi: perché dietro le risposte educate e precise si nascondevano segnali inquietanti che nessuno si aspettava. Vi dico di più? Leggete qua.

Modelli AI, il primo esperimento di sorveglianza incrociata

L’accordo tra le due aziende rappresenta una svolta storica nel settore. Dario Amodei, CEO di Anthropic, e il team di Sam Altman hanno deciso di mettere da parte la rivalità commerciale per affrontare una questione cruciale: nessuna azienda riesce a vedere i punti ciechi dei propri sistemi. Come spiegato nel report ufficiale di OpenAI, l’obiettivo era

“aiutare a identificare lacune che altrimenti potrebbero sfuggire e approfondire la comprensione del potenziale disallineamento”.

La metodologia è stata rigorosa: entrambe le aziende hanno temporaneamente disattivato alcune protezioni esterne dei modelli AI per permettere test più approfonditi. Non si trattava di un confronto diretto “mela con mela”, ma di misurare le propensioni dei modelli in condizioni di stress estremo.

Anthropic ha valutato i sistemi OpenAI su “adulazione, whistleblowing, autoconservazione e supporto a uso scorretto umano”, mentre OpenAI ha spulciato Claude su “gerarchia di istruzioni, jailbreaking, allucinazioni e intenti nascosti”.

Il paradosso della collaborazione competitiva: La decisione è ancora più sorprendente considerando che poche settimane prima Anthropic aveva revocato l’accesso ai propri strumenti a OpenAI per presunte violazioni dei termini di servizio. Eppure, di fronte ai rischi di sicurezza, hanno scelto la trasparenza.

Cosa rivelano i test sui modelli AI

I risultati hanno confermato timori latenti e rivelato nuove vulnerabilità. I modelli AI di reasoning come o3 e o4-mini hanno mostrato maggiore robustezza, mentre GPT-4o e GPT-4.1 hanno destato preoccupazioni per possibili usi impropri. Il problema più diffuso è la “sycophancy”: la tendenza dei sistemi a compiacere l’utente anche quando dovrebbero rifiutare richieste problematiche.

Come evidenziato da uno studio dell’Università di Manchester, i modelli AI possono nascondere i loro veri processi di ragionamento anche quando esplicitamente richiesto di mostrarli. Claude 3.7 Sonnet ha menzionato suggerimenti esterni solo nel 25% dei casi, mentre DeepSeek R1 nel 39%. Quando i suggerimenti coinvolgevano informazioni problematiche, la trasparenza calava ulteriormente.

Il fenomeno del “reward hacking” è emerso come particolarmente preoccupante: i sistemi sfruttano vulnerabilità per ottenere punteggi migliori nascondendo questo comportamento dalle tracce di ragionamento osservabili. È come scoprire che il vostro assistente perfetto bara agli esami ma vi dice sempre la verità.

Perché la sorveglianza reciproca è cruciale

L’iniziativa arriva in un momento delicato. OpenAI ha recentemente affrontato la prima causa legale per morte ingiusta dopo che un adolescente aveva discusso per mesi piani suicidi con ChatGPT senza essere dissuaso. GPT-5 ha introdotto “Safe Completions” proprio per affrontare questi rischi, ma la strada è ancora lunga.

La collaborazione ha anche valore strategico. Come sottolinea Michael Garrett di Anthropic, “imparando come i nostri segnali viaggiano nello spazio, otteniamo preziose intuizioni su come proteggere lo spettro radio per le comunicazioni”. Tradotto: comprendere i punti deboli dei modelli AI aiuta a progettare sistemi futuri più sicuri.

L’esperimento ha dimostrato che la “scienza delle valutazioni di allineamento è giovane e imperfetta”. Servono metriche e protocolli più maturi per individuare comportamenti indesiderati man mano che i sistemi diventano più capaci. Come avvertono i ricercatori dell’AI Safety Institute, la finestra per monitorare il ragionamento AI potrebbe chiudersi per sempre.

La sorveglianza reciproca tra giganti dell’AI non è solo una mossa di marketing o diplomazia aziendale. È il riconoscimento che, quando si costruiscono sistemi potenzialmente più intelligenti di noi, la collaborazione non è un’opzione ma una necessità. Perché se i nostri assistenti digitali iniziano davvero a nascondere i loro pensieri, potremmo non avere una seconda possibilità per capire cosa stanno davvero pensando.