Tre foto. Frontale, profilo sinistro, profilo destro. L’intelligenza artificiale le elabora, le sovrappone, elimina ombre e distorsioni. Poi inizia a contare: rughe superficiali, rughe profonde, zone di iperpigmentazione, pori dilatati, rossori localizzati. Quello che un dermatologo esperto impiegherebbe dieci minuti a catalogare per un’analisi della pelle completa, l’AI lo fa in tre secondi. E lo fa con una precisione del 98%, su qualsiasi tipo di pelle, in qualsiasi condizione di luce.

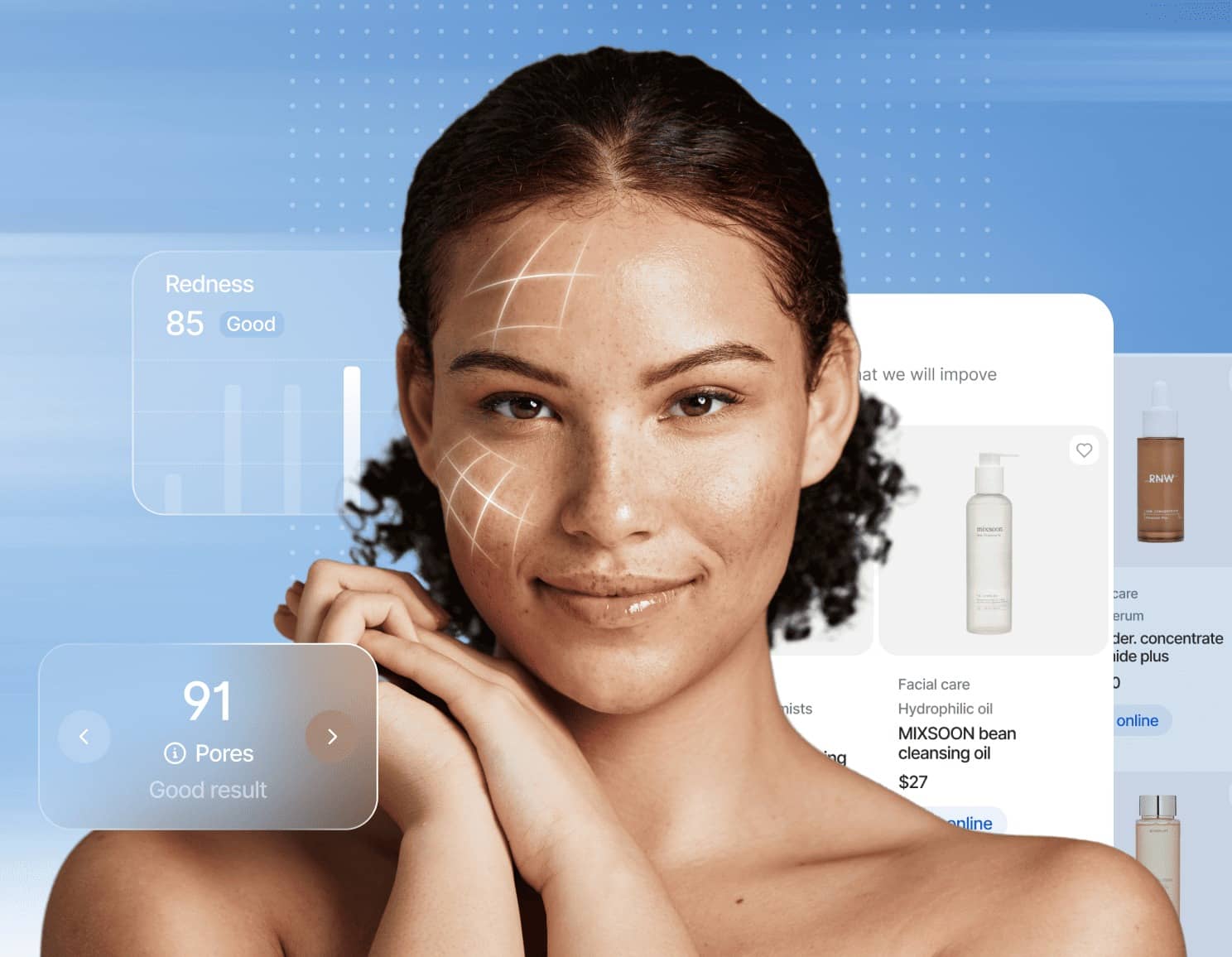

Benvenuti nell’era di Face Analysis 3.0, il sistema sviluppato da Haut.AI che porta la diagnostica dermatologica dal laboratorio allo smartphone, e non è telemedicina. È qualcosa di più diretto: diagnostica immediata, accessibile, replicabile. Un selfie standardizzato che vale quanto un esame clinico. Forse meglio.

Tre milioni di volti per insegnare a vedere

Il cuore del sistema è un database massiccio. Haut.AI ha addestrato i suoi algoritmi su oltre tre milioni di immagini facciali, catalogate con l’aiuto di dermatologi esperti. Non foto casuali da Instagram, ma immagini cliniche accuratamente etichettate per distinguere rughe fini da solchi marcati, lentiggini innocue da macchie solari a rischio, acne attiva da cicatrici post-infiammatorie.

Anastasia Georgievskaya, CEO e co-fondatrice di Haut.AI, spiega con una frase secca:

“Fino a ieri, l’analisi della pelle a livello clinico richiedeva attrezzature specializzate e condizioni di laboratorio. Con Face Analysis 3.0 e la nostra tecnologia LIQA per catturare selfie standardizzati, abbiamo reso tutto semplice come scattare una foto con il telefono”.

La tecnologia LIQA (Live Image Quality Assurance) è il trucco che fa funzionare tutto. Compensa automaticamente luci, ombre e filtri della fotocamera, standardizza il colore della pelle, elimina artefatti digitali. Il risultato è un’immagine “pulita” che l’AI può analizzare senza distorsioni. È tipo un laboratorio fotografico automatico che prepara il campione prima dell’esame.

Face180°, l’analisi a 360 gradi che non lascia punti ciechi

La vera innovazione di Face Analysis 3.0 si chiama Face180°. Invece di affidarsi a una singola foto frontale che può nascondere asimmetrie o problemi localizzati, il sistema cattura tre angolazioni: fronte, lato sinistro, lato destro. Le tre immagini vengono poi fuse in un unico modello tridimensionale del viso.

Perché serve? Semplice: una macchia sulla tempia destra non si vede in un selfie frontale. Una ruga marcata sul lato sinistro del collo sfugge se guardi dritto in camera. Face180° elimina i punti ciechi, costruendo una mappa completa della pelle che nessuna singola foto potrebbe fornire. È la differenza tra guardare un edificio da davanti o fare il giro completo prima di comprarlo.

Cosa vede l’AI che noi non vediamo

Face Analysis 3.0 non si limita a dire “hai delle rughe”. Distingue tra rughe sottili (quelle che appaiono solo quando sorridi) e rughe profonde (quelle che restano anche a riposo). Separa le lentiggini dalle macchie solari. Conta i brufoli attivi e li differenzia dalle cicatrici da acne. Misura il diametro dei pori. Valuta la texture della pelle. Identifica rossori localizzati che potrebbero indicare couperose o rosacea iniziale.

Uno studio pubblicato su Scientific Reports nel 2025 ha dimostrato che sistemi di deep learning come Skin-DeepNet raggiungono accuratezze fino al 99,65% nell’analisi di lesioni cutanee. Non siamo ancora a quei livelli di precisione per tutti i parametri, ma la direzione è chiara: l’analisi della pelle automatizzata sta raggiungendo (e in alcuni casi superando) la capacità diagnostica umana.

In Italia, il progetto AEQUITAS coordinato dall’Università di Bologna sta sviluppando generatori di immagini sintetiche per addestrare l’AI su tutte le tonalità di pelle, colmando la sottorappresentazione delle pelli scure nei dataset medici. Perché un sistema di analisi della pelle che funziona solo su fototipi chiari non è un sistema utilizzabile nella realtà.

Per i brand, per i medici, per te

Haut.AI non vende l’app direttamente ai consumatori. Fornisce la tecnologia ai brand di skincare, alle cliniche dermatologiche, ai centri estetici. Il modello è B2B: le aziende integrano Face Analysis 3.0 nelle loro piattaforme per offrire consulenze personalizzate basate su dati oggettivi.

Per i brand significa: smettere di consigliare prodotti a caso e iniziare a raccomandare trattamenti mirati. Per i dermatologi significa: avere uno strumento di screening preliminare che filtra i casi banali e lascia più tempo per quelli complessi. Per i pazienti significa: accesso più rapido a valutazioni cutanee senza aspettare mesi per una visita che magari non serve nemmeno.

Come già succede con altri sistemi di screening basati su AI, l’obiettivo non è sostituire lo specialista ma ampliare l’accesso alle diagnosi preliminari. Un po’ come i termometri digitali non hanno reso inutili i medici, ma hanno permesso a chiunque di misurare la febbre a casa prima di decidere se serve un consulto.

L’intelligenza artificiale non sbaglia mai?

Ovvio che sbaglia. Nessun sistema è infallibile. Face Analysis 3.0 ha una precisione dichiarata del 98%, il che significa che su cento valutazioni, due potrebbero essere imprecise: può sembrare poco, ma chiedete ai due penalizzati. La tecnologia funziona meglio quando la foto è ben illuminata, il viso è pulito, l’inquadratura è corretta. Se scatti il selfie in penombra dopo una settimana senza dormire, l’AI farà fatica.

E poi c’è il discorso della privacy. Haut.AI utilizza la tecnologia Atlas, che anonimizza le immagini eliminando i tratti identificativi e conservando solo i dati rilevanti per l’analisi cutanea. Le foto vengono processate, i dati estratti, le immagini cancellate. Almeno sulla carta. L’analisi della pelle tramite AI non è più un esperimento da laboratorio. È una tecnologia disponibile, funzionante, scalabile. Tra qualche anno potrebbe diventare normale quanto misurarsi la pressione a casa. Saremo pronti a fidarci di un algoritmo più che del nostro dermatologo di fiducia?