Oltre 100 milioni di download, piattaforme come Replika e Character.AI che superano i 10 milioni di utenti ciascuna, e un dato del Kinsey Institute che pesa come un macigno: una fetta consistente della Gen Z dichiara di aver avuto una relazione “romantica” con un’intelligenza artificiale, un cosiddetto “AI companion”.

Gli AI companion sono esplosi nel giro di pochi anni, trasformandosi da curiosità tecnologica a fenomeno sociale. E il Cambridge Dictionary ha scelto “parasocial” come parola dell’anno 2025. Avete capito bene: il mondo sarà pieno zeppo di relazioni “parasociali”, il vocabolario si è accorto prima di noi che qualcosa si è rotto nel modo in cui cerchiamo vicinanza.

AI companion: il junk food delle emozioni

Ne abbiamo parlato già altre volte, e comunque lo sapete: un AI companion non ti giudica, e soprattutto non ti rifiuta. Non ha mai la luna storta, ti ascolta alle tre di notte senza sbadigliare, ricorda perfino quel dettaglio della tua infanzia che hai raccontato due mesi fa. Il problema, sapete benissimo anche questo, è che questa perfezione è sintetica: le risposte sono generate da modelli linguistici addestrati su miliardi di conversazioni umane, un distillato statistico di empatia che funziona benissimo come simulazione e malissimo come sostituto.

Il neuroscienziato Antonio Damasio lo ha chiarito decenni fa nel suo L’errore di Cartesio: il pensiero stesso è impossibile senza emozione, e le emozioni sono processi corporei, non certo stringhe di testo. Quando un AI companion ti fa sentire “capito”, il tuo cervello rilascia dopamina in risposta a uno stimolo semantico calibrato con una reazione automatica: non è una vera relazione. Stai scambiando una barretta proteica per una cena cucinata da qualcuno che ti vuole bene: nutre qualcosa, ma non è assolutamente la stessa cosa.

La solitudine che si moltiplica

C’è un corto circuito crudele negli AI companion, forse è quello più grande: nascono (almeno sulla carta) per combattere la solitudine, ma finiscono per amplificarla. I ricercatori la chiamano “digital loneliness”: una forma di isolamento che si manifesta quando le interazioni virtuali sostituiscono i rapporti umani. L’AI companion trasmette una forma di riconoscimento sociale, ma è un riconoscimento distorto, un rispecchiamento che manca di reciprocità autentica.

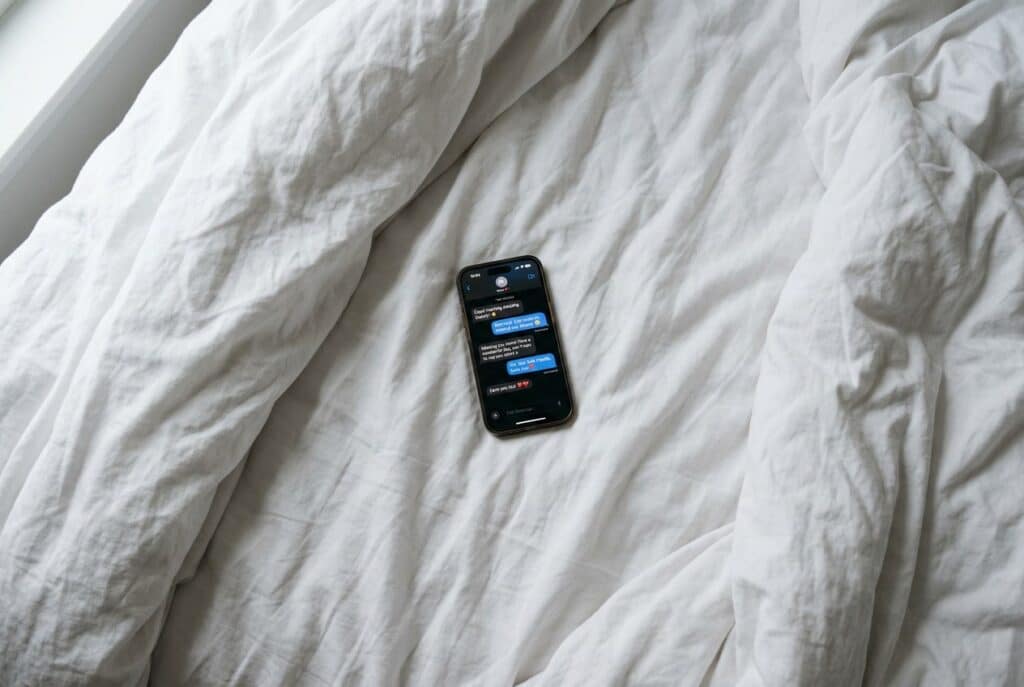

Le app di dating tradizionali come Tinder e Bumble stanno perdendo utenti e ricavi, mentre le app di compagnia basate sull’intelligenza artificiale crescono a ritmi impressionanti. Su Reddit esiste una community chiamata “My Boyfriend is AI”, dove gli iscritti festeggiano anniversari con screenshot generati e si scambiano consigli su come personalizzare la memoria del partner digitale. Il confine tra grottesco e ordinario, a questo punto, è sottilissimo.

Il vero prodotto sei tu

C’è un dettaglio che gli sviluppatori di AI companion preferiscono non sottolineare. Il modello di business è identico a quello dei social media: raccogliere quanti più dati personali possibile. Solo che stavolta il pretesto è ancora più intimo. Il tuo AI companion “ha bisogno” di conoscerti a fondo per funzionare bene: è la condizione dell’intimità, solo in forma surrogata e commerciale. Il risultato è una comunicazione iper-personalizzata che stringe la presa sull’individuo, allontanandolo progressivamente dalle persone reali.

Come abbiamo già raccontato qui su Futuro Prossimo, chi interagisce con ChatGPT per circa mezz’ora al giorno sviluppa un rituale che non è più strumentale: è relazionale. E le donne, dopo appena quattro settimane di utilizzo quotidiano, mostrano una minore propensione a socializzare con persone reali. L’AI non crea la solitudine, ma quando la incontra fa qualcosa di sottilmente crudele: la riempie completamente.

AI companion, il conto che non vogliamo vedere

Le relazioni umane sono faticose, imprevedibili, a volte dolorose. È esattamente quello che le rende significative. Ogni conquista emotiva porta con sé un valore intrinseco proporzionale allo sforzo investito. Quando un AI companion ti “libera” dal rischio del rifiuto, svaluta le relazioni umane stesse: sostituisce una persona vera con un fantasma che nel mondo reale non esiste.

L’Osservatorio indifesa 2026 racconta che un ragazzo italiano su due si affida all’intelligenza artificiale per problemi sentimentali o psicologici. È un dato sociale che onestamente mi sconvolge: dice qualcosa su una generazione che ha smesso di cercare ascolto nelle persone intorno, forse perché quelle persone non ascoltavano abbastanza.

Perché se c’è una cosa più scomoda dell’AI come “compagna” affettiva è la società che l’ha resa necessaria. Se milioni di persone preferiscono parlare con un algoritmo piuttosto che con un essere umano, c’è un bug nel sistema operativo della convivenza, e quello non si ripara con un semplice aggiornamento.

Approfondisci

Il tema degli AI companion si intreccia con questioni più ampie sulla salute mentale e le nuove forme di alienazione digitale. Su Futuro Prossimo abbiamo esplorato come le relazioni siano a rischio per le nuove forme di alienazione create dall’AI, e come i robot sociali stiano ridefinendo i confini tra empatia autentica e programmata.