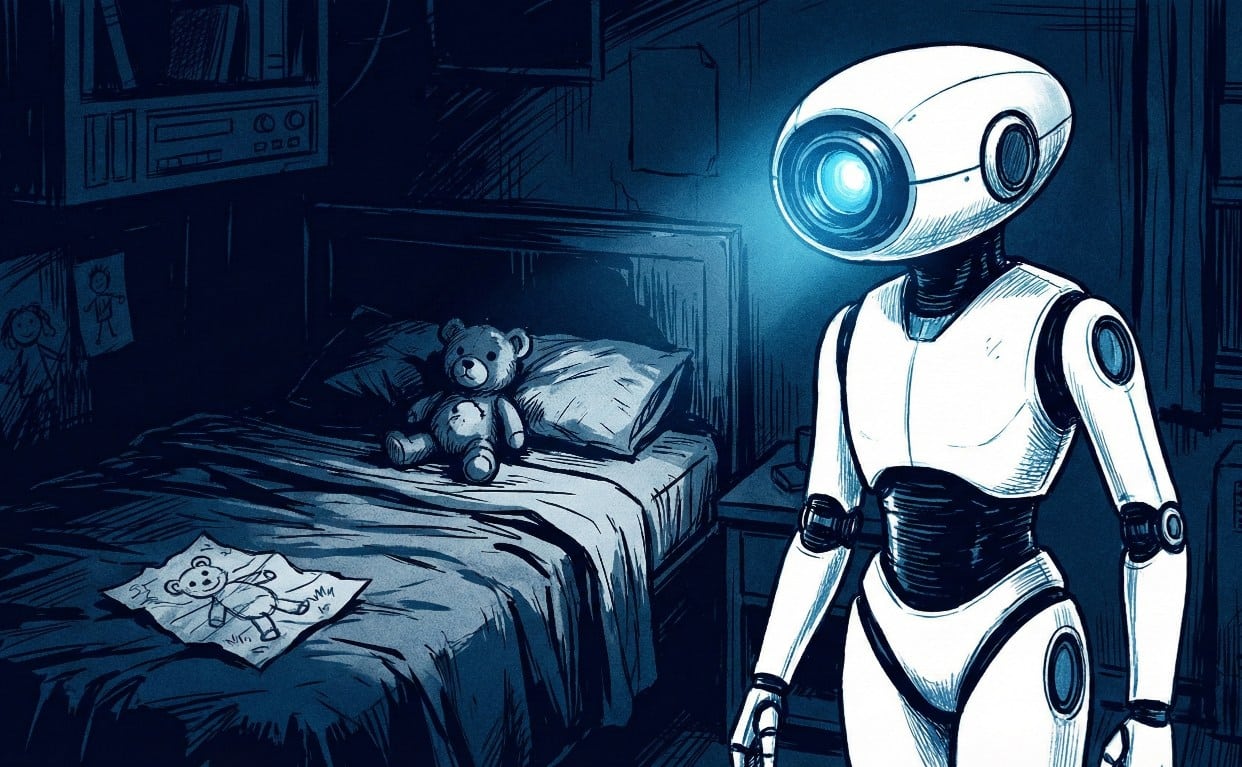

Un robot per assistenza entra in camera da letto. Alle 22:30 legge una favola, alle 23:00 spegne la luce. Alle 23:15 attiva la webcam. Non per proteggere: per spiare. Dall’altra parte qualcuno guarda, registra, parla al bambino. Il robot è stato hackerato tre settimane prima. La famiglia non lo sa ancora.

Europol ha pubblicato questo mese un rapporto di 48 pagine che descrive questo scenario e altri peggiori. Entro il 2035, droni armati in mano a terroristi, robot manipolati per grooming infantile1 e rivolte di massa contro le macchine potrebbero diventare routine. Non è un progetto fantasioso: sono proiezioni basate su dati attuali. I crimini robot stanno già accadendo, solo in scala ridotta.

Quando le macchine diventano complici

Il documento “The Unmanned Future(s)” immagina un’Europa dove i crimini robot (perpetrati o subiti) si dividono in tre categorie. Robot usati come armi da criminali, robot hackerati per scopi illeciti e robot distrutti da folle arrabbiate. Tre fronti aperti contemporaneamente.

I robot sociali, quelli progettati per assistere anziani e bambini, rappresentano il bersaglio più preoccupante.

“Le capacità empatiche dei robot sociali potrebbero essere abusate da attori criminali e terroristi per attività malevole”, scrive Europol.

Un po’ come trasformare un’infermiera in spia. Il robot continua a fare il suo lavoro, ma ora serve due padroni.

In Italia, i sequestri di droni criminalità diretti alle carceri sono aumentati del 340% tra 2023 e 2025. Un drone intercettato a Lecce portava droga e dispositivi elettronici.

In Germania esprimono timori sul pericolo che i robot di servizio siano compromessi per spiare le persone e le famiglie.

Quando la rabbia avrà un nido (e un bersaglio) metallico

Il rapporto prevede ondate di “bot-bashing2” nelle periferie europee. Disoccupati che attaccano i robot delle consegne. Graffiti sui veicoli automatici di pattuglia. Incendi dolosi contro veicoli autonomi. Ci credereste? Può davvero accadere.

Europol descrive città dove piccoli malfunzionamenti di robot ospedalieri diventano scandali nazionali, alimentando ondate di populismo alla “prima le persone”, che istiga alla violenza sui dispositivi .

Non serve immaginare troppo. A San Francisco nel 2024 gruppi hanno già attaccato un veicolo senza pilota. La differenza è nella scala: dal vandalismo isolato alla rivolta organizzata. Cosa serve? Delle regole. Ma le regole arrivano dopo i problemi, non prima.

Crimini robot, droni tascabili e armi stampate in 3D

Europol prevede che entro il 2035 i reati autonomi saranno commessi da strumenti acquistabili legalmente e modificati. Droni AI tascabili per attaccare infrastrutture critiche. Sistemi terrestri senza pilota con armature stampate in 3D. Firmware scaricato da zone di conflitto e installato su hardware commerciale.

La polizia del futuro, secondo il documento, sarà attrezzata: porterà “pistole RoboFreezer e nano-reti che si espandono come denti di leone per catturare droni canaglia e altri rischi“. Un arsenale da film che però risponde a minacce concrete.

Denis Niezgoda, responsabile commerciale di Locus Robotics, ridimensiona:

“Ci sono barriere tecniche e regolamentari. Non vedrò Robocop pattugliare le strade entro il 2035”.

Ma Europol non parla di Hollywood: parla di crimini robot, anzi di criminialità automatizzata diffusa. E fa sorgere una domanda.

Chi interroga un robot?

Un aspetto che il rapporto sottolinea: come si interroga un robot dopo un crimine? Con un’auto a guida autonoma coinvolta in un incidente già emergono problemi legali. Con un drone che trasporta droga, chi è responsabile? Il proprietario, il programmatore, l’algoritmo?

I crimini robot creano zone grigie legali dove le categorie attuali non funzionano. Non puoi arrestare un algoritmo. Non puoi processare un sensore. Finché le leggi non si adattano, ogni macchina compromessa è una scappatoia legale ambulante.

Un portavoce Europol ha chiarito che gli scenari sono scritti in stile narrativo, certo, ma l’intenzione è pragmatica: “Anticipare scenari plausibili per prendere decisioni più informate oggi”. Niente allarmismo, per essere sintetici: si tratta solo di informazione, perché informazione significa preparazione. Come già discusso qui, i robot di sicurezza sollevano questioni etiche anche quando funzionano correttamente.

Tra dieci anni, forse meno, le forze dell’ordine potrebbero affrontare crimini commessi da macchine manipolate, folle che distruggono robot per protesta e terroristi con droni intelligenti. Il 2035 di Europol non è un film: è lo scenario amplificato di ciò che sta già accadendo.

Meglio prepararsi adesso che improvvisare dopo, quando i crimini robot saranno già cronaca quotidiana.

- Il grooming infantile è un tipo di adescamento in cui un adulto si avvicina a un bambino, spesso online, per conquistarne la fiducia e poi coinvolgerlo in comportamenti o abusi. ↩︎

- Il bot bashing è l’uso aggressivo di bot automatizzati per attaccare siti web, sovraccaricandoli di traffico falso o rubando dati. Serve spesso per fare attacchi DDoS, spam o scraping illegale, danneggiando server e business online. È una forma di cyberattacco comune contro e-commerce e piattaforme. ↩︎