Cinque anni per insegnare a un robot assistivo come infilzare una banana senza farla scivolare dalla forchetta. Sei mesi per addestrarlo a riconoscere la differenza tra una fragola e un pezzo di sedano. Migliaia di immagini, dozzine di sensori, algoritmi che processano forze e angoli in tempo reale. Il risultato? Un minuto per boccone: oggi ne servono molti di più minuti ad una persona paralizzata quando usa un braccio robotico con joystick.

Siddhartha Srinivasa, professore alla University of Washington, lo sapeva dal 2014, quando incontrò una bambina di 11 anni in carrozzina. Le chiese “Cosa potrei costruire per te?”. La risposta: “Voglio mangiare da sola”. Lui annuì, ma dentro pensò: ci vorranno decenni.

Aveva ragione, più o meno.

Il problema non è tecnologico

Negli Stati Uniti circa un milione di persone non può mangiare senza aiuto. In Italia parliamo di decine di migliaia. Lesioni spinali, distrofia muscolare, sclerosi laterale amiotrofica: condizioni che rendono impossibile anche solo portare una forchetta alla bocca. Tyler Schrenk, 34 anni, usa tecnologia assistiva da quando un incidente gli ha causato una lesione midollare nel 2012. Controlla luci, termostato, porte con la voce. Ma mangiare? Quello è un altro mondo.

Un braccio robotico Jaco montato su una carrozzina costa circa 30mila dollari. Lo controlli con un joystick o un sistema a soffio. Schrenk ci metteva 45 minuti per portarsi in bocca tre bocconi. “Rinunciavo. Era più veloce aspettare qualcuno”, racconta. È comprensibile: ogni movimento richiede coordinazione millimetrica tra mano, polso, gomito, spalla. Noi lo facciamo senza pensarci. Un sistema robotico, invece, deve calcolare ogni angolo.

Addestrare un robot assistivo a mangiare

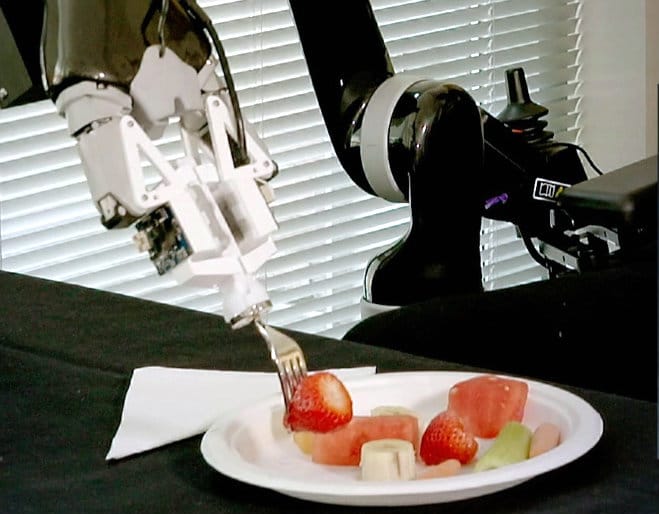

Nel 2017, il team di Srinivasa ha iniziato con 16 cibi: fragole, banane, broccoli, carote, pomodorini, uva e altri. Hanno creato modelli tridimensionali iperrealistici in resina colorata (il cibo vero si deteriora sotto le luci). Poi hanno fotografato ogni combinazione possibile su un piatto. 478 immagini totali. Perché? Perché un pomodoro coperto per metà da un pezzo di banana non è più “un pomodoro”: per l’intelligenza artificiale, è un problema nuovo.

I ricercatori hanno usato RetinaNet, un sistema di riconoscimento visivo rilasciato da Facebook nel 2017. E sembra funzionare. Il robot assistivo ADA riconosce cosa c’è nel piatto: certo, poi deve decidere come infilzarlo. Una carota si attacca meglio verticalmente. Una banana morbida scivola via se la colpisci frontalmente: serve un angolo obliquo. Il sedano, lungo e fibroso, va preso da un’estremità, non al centro. Altrimenti penzola dalla forchetta in modo impossibile da mordere. Ma voi, a tutti questi dettagli, avreste mai pensato?

Il team ha registrato centinaia di persone mentre mangiavano. Hanno estratto le strategie vincenti per ogni tipo di cibo. Hanno addestrato una rete neurale a replicarle. Ci sono voluti mesi. Ora ADA infilza il cibo correttamente nel 90% dei casi. Il problema vero, però, arriva dopo.

Gli ultimi cinque centimetri

Portare la forchetta dal piatto al viso è questione di ingegneria: portarla dal viso alla bocca è questione di etica. Chi ha disabilità motorie gravi spesso ha anche un controllo limitato del collo, non può scostarsi se la forchetta arriva storta. E molti hanno aperture boccali ridotte, sotto i due centimetri. Altri soffrono di spasmi muscolari involontari, anche con il cibo in bocca.

ADA usa due telecamere: una sopra, una sotto la forchetta. Traccia la posizione della bocca in tempo reale e non assume mai che la persona resterà ferma. Per cui si ferma a pochi millimetri di distanza, poi aspetta che la persona si sporga leggermente in avanti per mordere il cibo. Un sensore di forza integrato nella forchetta rileva ogni resistenza: se qualcosa non va, il robot assistivo si ritira immediatamente. C’è ancora del lavoro da fare.

Scheda dello Studio

- Ente di ricerca: University of Washington, Personal Robotics Lab

- Ricercatori principali: Siddhartha S. Srinivasa, Tapomayukh Bhattacharjee

- Anno pubblicazione: 2019

- Rivista: IEEE Robotics and Automation Letters

- Hardware: Braccio robotico Jaco (Kinova Robotics, Canada)

- Software: RetinaNet (computer vision), SPNet (strategie di infilzamento)

- TRL (Technology Readiness Level): 6 – Sistema dimostrato in ambiente rilevante con utenti reali

Quando arriverà davvero un robot assistivo?

Un minuto per boccone significa circa 30-40 minuti per un pasto completo. Non è veloce. Ma è molto, molto più rapido del joystick manuale. Schrenk, che ha testato ADA nell’inverno 2019, lo dice chiaramente: “Anche solo per mangiare snack quando voglio sarebbe fantastico”. Non è ancora libertà totale, ma ne è un bel pezzo.

Il sistema attuale gestisce solo cibi solidi e separabili. Niente riso, niente purè, niente spaghetti. Srinivasa è onesto:

“Per un sistema davvero flessibile ci vorranno altri 10-20 anni”.

Ma versioni intermedie? Quelle potrebbero arrivare prima. Un robot assistivo che gestisce 16 cibi ben definiti potrebbe essere commercializzato in un paio d’anni. Non per tutti. Per chi quelle 16 opzioni bastano a cambiare la giornata.

Obi, un robot simile sviluppato da un’azienda americana, è già in commercio a 300 dollari al mese. Richiede però l’aiuto di un caregiver per il setup iniziale, e non è autonomo. ADA punta all’autonomia completa: controllo vocale, riconoscimento automatico, adattamento in tempo reale.

La bambina di Chicago oggi ha 21 anni. Il robot assistivo che ha ispirato non è ancora sul mercato, ma esiste già. E ha dimostrato che il problema non è se si può fare: è quanto tempo vogliamo aspettare prima che diventi accessibile a chi ne ha bisogno.

Non domani, certo. Ma nemmeno tra vent’anni.

Approfondisci

Ti interessa la robotica assistiva? Leggi anche come i robot assistenti stanno cambiando il concetto di fiducia tra umani e macchine. Oppure scopri come i robot caregiver potrebbero trasformare l’assistenza agli anziani nei prossimi anni.