Secondo una ricerca, le settimane successive alla dimissione da un ospedale psichiatrico sono un periodo notoriamente difficile per le persone fragili, con tassi di suicidio molto superiori alla media.

Ora i progressi dell’intelligenza artificiale potrebbero cambiare le regole del gioco, aiutando gli psichiatri a prevedere i tentativi di suicidio e a intervenire in tempo.

AI e salute mentale

L’apprendimento automatico, che impiega algoritmi informatici per prevedere meglio il comportamento umano, è un campo in rapida crescita nel campo della salute mentale. Una crescita che fa il paio con quella dei biosensori capaci di monitorare l’umore di una persona in tempo reale tenendo conto di scelte musicali, espressioni facciali, tono vocale e perfino post scritti sui social media.

Matthew K. Nock, psicologo di Harvard e attento ricercatore del fenomeno dei suicidi spera di unire queste tecnologie in una sorta di sistema di allerta precoce da usare quando un paziente a rischio viene dimesso dopo un ricovero psichiatrico.

Come potrebbe funzionare il sistema anti suicidio

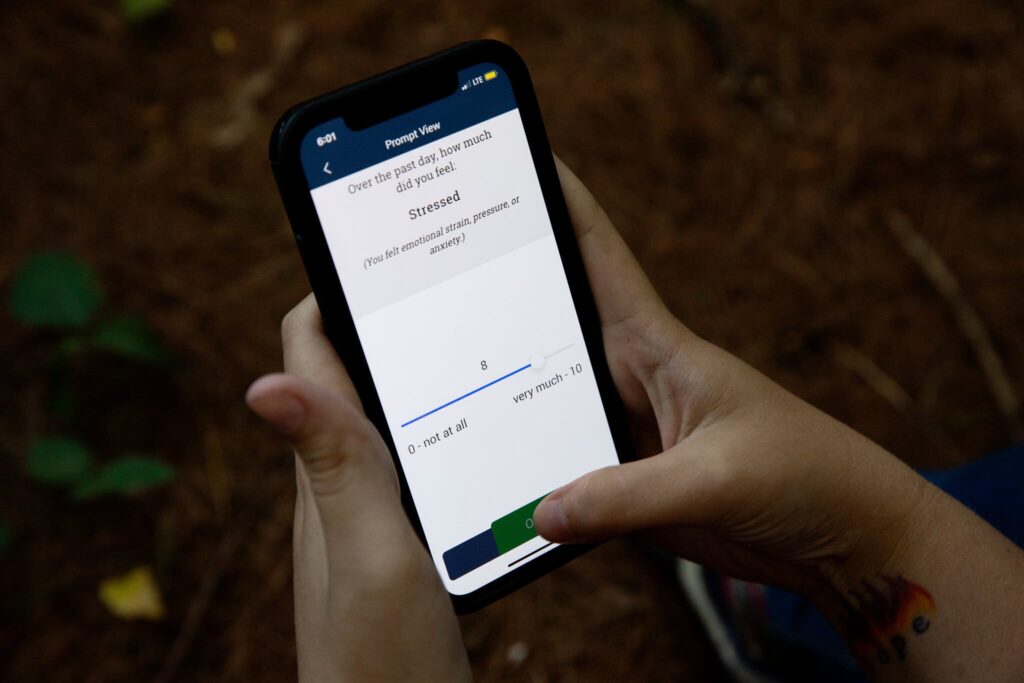

Un sensore segnala che il sonno di un paziente è disturbato, il GPS mostra che non sta uscendo di casa. L’accelerometro sul suo telefono mostra che si sta muovendo molto, suggerendo agitazione. Il paziente riporta un umore basso sui consueti questionari.

A questo punto, l’algoritmo contrassegna il paziente. E un medico entra in contatto con lui attraverso una telefonata o un messaggio.

Può funzionare? Non è facile prevederlo. Ci sono diverse ragioni per dubitare che un algoritmo possa mai raggiungere questo livello di accuratezza. Anche tra le persone a più alto rischio, il suicidio è un evento talmente raro che qualsiasi tentativo di previsione può portare a falsi positivi, con interventi su individui che non ne hanno bisogno. Ed eventuali falsi negativi, invece, porterebbero un peso etico sulle responsabilità legali di aver omesso un intervento.

Prevenzione del suicidio, serve coraggio

Per perfezionare una intelligenza artificiale sono necessari dati granulari a lungo termine di un gran numero di persone, ed è difficile ottenerli, perchè per fortuna il suicidio, per quanto terribile, è un evento raro. Senza contare il fatto che i dati necessari al monitoraggio sollevano enormi questioni di privacy, peraltro sulla vita di persone già vulnerabili.

Eppure Nock non demorde. Qualcosa va fatto, e serve coraggio. “Con tutto il rispetto per chi fa questo lavoro da decenni, in un secolo non abbiamo imparato niente su come identificare le persone a rischio di suicidio e su come intervenire”, afferma.

Il tasso di suicidi oggi è lo stesso di 100 anni fa. Quindi, va detto con onestà, non stiamo migliorando.

Matthew K. Nock

Un compito difficile

Non c’è niente di più snervante per uno psichiatra che prendersi cura di pazienti a rischio di suicidio mentre non sono sorvegliati e si trovano a casa. È una complicatissima “zona grigia”. Con l’esperienza, diventa solo più chiaro che i pensieri suicidi possono andare e venire senza preavviso.

Per questo, sempre più spesso i sistemi sanitari più avanzati si rivolgono all’apprendimento automatico per andare avanti. Gli algoritmi basati su vasti set di dati tratti da cartelle cliniche elettroniche e da numerosi altri fattori, vengono usati per assegnare ai pazienti un punteggio di rischio, prestando più attenzione agli individui con rischio eccezionalmente alto.

Sembra, peraltro, che gli algoritmi si siano dimostrati più accurati dei metodi “tradizionali”, sempre gli stessi da 50 anni, secondo una ricerca del 2017. Proprio dal 2017, il Department of Veterans Affairs negli USA ha usato un algoritmo per segnalare lo 0,1% dei veterani a più alto rischio di suicidio.

Parliamo di poche migliaia di pazienti su una popolazione di sei milioni.

Risultato? I pazienti iscritti a questo programma avevano il 5% in meno di probabilità di tentare il suicidio. Una goccia nel mare, che non cambia i tassi complessivi. L’impressione è che abbiamo iniziato a fare cose che non si sono mai fatte prima, ma non abbiamo ancora trovato quello che cerchiamo.

Alla ricerca di uno schema

“Non è facile individuarli”, dice Nick Allen, direttore del Center for Digital Mental Health presso l’Università dell’Oregon. Allen ha contribuito a sviluppare EARS, un’app che tiene traccia dell’umore in base a fattori come la scelta della musica, l’espressione facciale e il tono verbale.

Da lì potrebbe arrivare una svolta. E torniamo al dottor Nock.

Lo scorso agosto un data scientist chiamato Adam Bear sedeva davanti a un monitor nel laboratorio del dottor Nock fissando i grafici a zigzag dei livelli di stress di un pazente nel corso di quella settimana. Cercava uno schema: qualcosa che si ripete, e può consentire di individuare in anticipo qualcuno che tenterà il suicidio.

Per questo, Bear ha passato tutta l’estate ad esaminare i dati di 571 pazienti che dopo aver pensato o tentato il suicidio hanno accettato di essere monitorati. Durante il programma, durato sei mesi, due tra loro si sono tolti la vita, e 100 hanno tentato di farlo.

In sintesi: questo è il più grande serbatoio di informazioni mai raccolto sulla vita quotidiana delle persone alle prese con pensieri suicidi.

Quali sono gli indizi di un possibile suicidio

Il team di Nock è molto interessato ai giorni precedenti ai tentativi di suicidio, perchè sono il momento in cui si potrebbe intervenire. Sono già emersi alcuni segnali: sebbene gli impulsi suicidi spesso non cambino nel periodo precedente un tentativo, sembra diminuire la capacità di resistere a questi impulsi. Con un indizio ricorrente, la privazione del sonno, che sembra contribuire molto.

Un piccolo segnale, ma importantissimo, che forse ci esorta ad insistere. Non siamo mai riusciti a osservare persone con pensieri suicidi, perchè è diverso dall’osservare, per dirne una, gente con malattie cardiache.

”La psicologia,” dice Nock, “non è progredita quanto le altre scienze perchè non ha avuto a disposizione molti strumenti”.

Con l’avvento di smartphone e biosensori indossabili, però, abbiamo la possibilità di raccogliere così tanti dati da recuperare questo svantaggio.

Un angelo senza volto

Un dilemma che i ricercatori hanno vissuto nel corso studio era cosa fare quando i partecipanti mostravano un forte desiderio di farsi del male. Il dottor Nock ha deciso che avrebbero dovuto intervenire, anche se questo rallentava la ricerca (e per alcuni pazienti la vanificava).

“C’è un aspetto negativo in questo,” dice lo scienziato, “perché paradossalmente così si ottengono meno suicidi e quindi meno probabilità di trovare un segnale. Ma se quel tale paziente fosse mio figlio?”.

Per questo lo studio è diventato anche una task force anti suicidio, e gli interventi sono diventati una parte di routine della vita in laboratorio. Se durante il monitoraggio un paziente capitava in un momento critico, riceveva una telefonata entro 15 minuti da uno dei ricercatori.

“Siamo una specie di persona senza volto, quindi c’è meno disagio”, dice Narise Ramlal, un’assistente ricercatrice del laboratorio. Ma il dottor Nock cerca di capire se interventi digitali possano rivelarsi più efficaci.

“Molte persone non vogliono che un essere umano li contatti quando sono ad alto rischio”, ha detto. “Non voglio dire che sostituiremo gli esseri umani con le macchine, ma a volte possono essere molto più efficienti di quanto lo siamo ora”.

Una storia emblematica

A marzo, la 39enne Katelin Cruz ha lasciato il suo ultimo ricovero psichiatrico con molta determinazione, ma anche fragilità e paura. Per questo ha deciso di partecipare al monitoraggio. Stava studiando per una laurea in infermieristica quando una serie di crisi mentali ha mandato la sua vita in pezzi.

Erano circa le 21:00, poche settimane dopo l’inizio dei sei mesi di studio, quando sul suo telefono è apparsa una domanda: “In questo momento, quanto è forte il tuo desiderio di ucciderti?”

Senza fermarsi a pensare, Katelin ha toccato lo schermo: 10. Pochi secondi dopo, le è stato chiesto di scegliere tra due affermazioni: “Oggi sicuramente non mi ucciderò” e “Oggi mi ucciderò sicuramente”. Ha scelto la seconda frase.

Quindici minuti dopo, il suo telefono ha squillato. Era un membro del gruppo di ricerca che la chiamava, aveva già allertato la polizia e ha tenuto Katelin in linea finché la polizia non ha bussato alla sua porta: subito dopo, Katelin ha avuto un crollo emotivo ed è svenuta.

Che arrivi o no a risolvere il problema, la tecnologia contro il suicidio può già fare qualcosa: esserci.

Katalin ha iniziato a rispondere con puntualità ai sei “richiami” che riceveva ogni giorno, quando l’app sul suo telefono l’ha interrogata sui suoi pensieri suicidi. Le notifiche? All’inizio invadenti, poi confortanti.

“Non mi sentivo più ignorata”, dice. “Avere qualcuno che sa come mi sento mi toglie un po’ di peso”. Pensa che la tecnologia (la sua “neutralità”, la sua “mancanza di giudizio”) renda più facile chiedere aiuto. “Penso che sia quasi più facile dire la verità a un computer”, ha detto.

Molti esperti pensano che possa essere anche il contrario.I pazienti in crisi sono abili nell’ingannare gli operatori sul loro stato di salute, e con un computer è pià facile anche mentire. Molto meglio le persone: un gruppo di supporto che si incontra ogni settimana, un cerchio di sedie, una rete di amici, familiari e medici.

Non tutti ce l’hanno. In Italia, la lista di attesa per un terapeuta in un centro pubblico di Salute Mentale può arrivare a tre mesi. Negli USA è di otto mesi.

E dimmi che non vuoi morire

La scorsa settimana, al termine della sperimentazione clinica di sei mesi, Katalina ha compilato il suo ultimo questionario con un po’ di tristezza. Le mancherà la sensazione che qualcuno la stia guardando, anche se è qualcuno senza volto, a distanza, attraverso un dispositivo.

Ci sono volte, pochissime, in cui un “Grande Fratello” può far stare meglio. Lo avreste mai detto?

“Onestamente, mi faceva sentire un po’ più sicura sapere che a qualcuno importava abbastanza da leggere quei dati ogni giorno,” dice Katalina.

E io le credo.

Se stai pensando al suicidio, chiama il 112 o parlane con il Telefono amico: tutti i giorni dalle 10 alle 24, al numero 02 23272327 o con chiamata web gratuita su www.telefonoamico.net