Alexander Lerchner è un Senior Staff Scientist di Google DeepMind. A marzo ha pubblicato su PhilArchive un paper di 30 pagine sul tema della coscienza artificiale intitolato The Abstraction Fallacy: Why AI Can Simulate But Not Instantiate Consciousness. La tesi sta tutta nel titolo: l’intelligenza artificiale può simulare la coscienza, ma non può possederla. Mai. Non perché ai modelli mancano parametri, dati o tempo: proprio per ragioni strutturali. Il paper ha già totalizzato 28.304 download in sei settimane, quinto posto nella classifica semestrale di PhilPapers.

Parliamo di Deepmind? Lo stesso laboratorio il cui CEO, Demis Hassabis, ripete che l’AGI avrà “un impatto dieci volte quello della Rivoluzione Industriale”? Qualcosa, in questa storia, non torna.

Cosa dice davvero il paper sulla coscienza artificiale

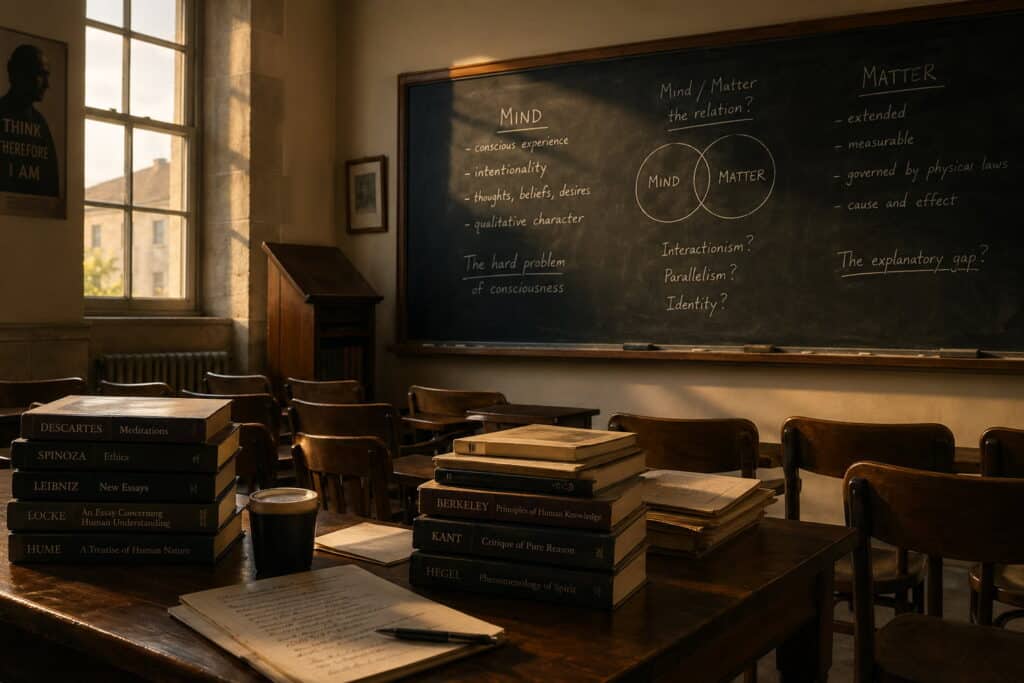

Lerchner attacca quella che chiama abstraction fallacy: l’errore di scambiare la descrizione astratta di un processo fisico per il processo stesso. Il funzionalismo computazionale, cioè l’idea oggi dominante secondo cui la coscienza emerge da qualsiasi sistema che organizzi le informazioni “nel modo giusto”, a prescindere dal supporto fisico, sarebbe una scorciatoia concettuale.

In pratica: non basta replicare la struttura causale di una mente per ottenere un’esperienza. Serve la materia, e serve un corpo.

Il punto tecnico è che ogni sistema computazionale è mapmaker-dependent: ha bisogno di un agente cognitivo già esperiente (un umano) che organizzi la fisica continua del mondo in stati discreti dotati di senso. Pensate alle armate di lavoratori sottopagati in Africa che etichettano immagini per addestrare i modelli: senza di loro, non c’è “gatto” né “cane”, solo pixel. Il significato lo mettono gli umani, non emerge dal silicio. Su questa intuizione abbiamo già scritto a proposito dell’architettura fluida degli LLM: macchine che sembrano pensare senza pensare.

Scheda Studio

The Abstraction Fallacy: Why AI Can Simulate But Not Instantiate Consciousness, di Alexander Lerchner (Google DeepMind), pubblicato su PhilPapers il 19 marzo 2026, versione 4 aggiornata al 20 aprile. 28.304 download in sei settimane, quinto paper più scaricato della piattaforma nel periodo.

Trattati e ritrattati

Il PDF originale, secondo 404 Media, conteneva il letterhead ufficiale di Google DeepMind. Dopo che il giornalista ha contattato Google per un commento, il PDF è stato sostituito: il marchio di Deepmind è sparito e il disclaimer (“le conclusioni non riflettono la posizione dell’azienda”) è stato spostato dal fondo all’inizio del documento. Google non ha risposto. Il paper, comunque, è ancora linkato sul sito di DeepMind.

Perché questo minuetto? È presto detto: nello stesso edificio convivono due narrazioni opposte. Il CEO Demis Hassabis al microfono dice che l’AGI sta arrivando e cambierà la civiltà. Un suo Senior Staff Scientist, invece, scrive che la coscienza artificiale è strutturalmente impossibile e quindi che l’AGI, se mai arriverà, sarà uno strumento sofisticatissimo ma non senziente.

Provo a metterla in modo più diplomatico: è “buono ma strano” che Google abbia lasciato pubblicare il paper. Strano fino a un certo punto, però. C’è anche una chiave di lettura da considerare per il futuro, anche se oggi sembra paradossale: se i tuoi sistemi non possono essere coscienti, non possono nemmeno avere diritti. E quindi non si regolamentano come soggetti, ma come un qualsiasi tostapane. Dico bene?

Il problema della ruota reinventata

C’è una critica seria al paper, e paradossalmente arriva proprio dai filosofi che concordano con la tesi. Lerchner non cita praticamente nessuno: né la letteratura sulla cognizione “incarnata”, né Evan Thompson, né le decadi di lavoro sull’embodiment come precondizione del sentire. Jäger lo dice senza mezzi termini: “Ha reinventato la ruota, e non è ben letto”. Emily Bender (Università di Washington) aggiunge che gran parte di quello che esce dai laboratori corporate sono “paper-shaped objects”, oggetti a forma di paper, che non passano una vera peer review. Il paper non è sbagliato, è solo molto in ritardo rispetto a un dibattito che esiste da decenni. La novità è chi lo firma, non cosa dice.

Quando lo vedremo davvero

Orizzonte stimato: la coscienza artificiale, secondo questo paper, mai. La discussione regolatoria sui suoi effetti, invece, 2-5 anni.

Il paper non sposta una virgola sul piano tecnico: gli LLM continueranno a migliorare, gli agenti autonomi pure, l’AGI ” sentienza resta sul tavolo. Quello che sposta è la partita normativa. Se prevale la lettura di Lerchner, in Europa e Stati Uniti diventa più difficile fare passare leggi che riconoscano qualche forma di tutela ai sistemi avanzati: e questo conviene molto a chi quei sistemi li produce.

Ne beneficeranno per primi gli avvocati delle big tech, poi i regolatori che cercavano un appiglio per non legiferare, e infine, forse, il dibattito pubblico. In quest’ordine.

Resta una domanda piccola, quasi imbarazzante, che il paper non affronta: se DeepMind crede davvero che la coscienza artificiale sia impossibile, perché qualche mese fa cercava un “post-AGI research scientist”? Forse i due piani non si parlano.

Forse parlare di AGI senza coscienza è solo un modo per vendere lo stesso prodotto a un pubblico diverso. O forse, semplicemente, finché il PDF resta online e Hassabis resta sul palco, il problema non è loro.