I data center mangiano elettricità come se fosse gratis (si…magari) e un terzo se ne va solo per non farli fondere. Aria fredda, presto! Ad ogni costo: e giù tra ventilatori e condizionatori, col bilancio energetico sempre più compromesso. Un team dell’Università dell’Illinois Urbana-Champaign ha appena pubblicato su Cell Reports Physical Science una soluzione che, sulla carta, taglia quel 30% di consumo per il raffreddamento ad appena l’1,1%.

Come? Con un sistema di alette in rame puro progettate da un algoritmo e stampate in 3D a livello atomico. Funziona. In laboratorio, dico: il resto, come sempre, è un’altra storia.

Il conto della serva nei data center

Partiamo dai numeri, che qui contano più delle parole: un data center da un gigawatt (la potenza di una città media) consuma in realtà 1,55 GW. Eh già. C’è il gigawatt che fa girare i modelli di AI, le ricerche, lo storage, e poi ci sono 550 megawatt aggiuntivi che servono solo a raffreddare i chip. Soffiano aria, in pratica.

Le stime sono FOLLI: dicono che entro il 2028 i data center americani divoreranno il 12% dell’intero carico energetico nazionale, e l’aria condizionata è il pezzo più stupido di quel consumo. I ricercatori dicono che è come provare a spegnere un incendio boschivo con un ventilatore da scrivania. La direct-to-chip cooling a liquido esiste già, ma le piastrine standard sono ottimizzate per costare poco, non per raffreddare bene. E ci riescono? Vediamo.

Alette disegnate da un algoritmo

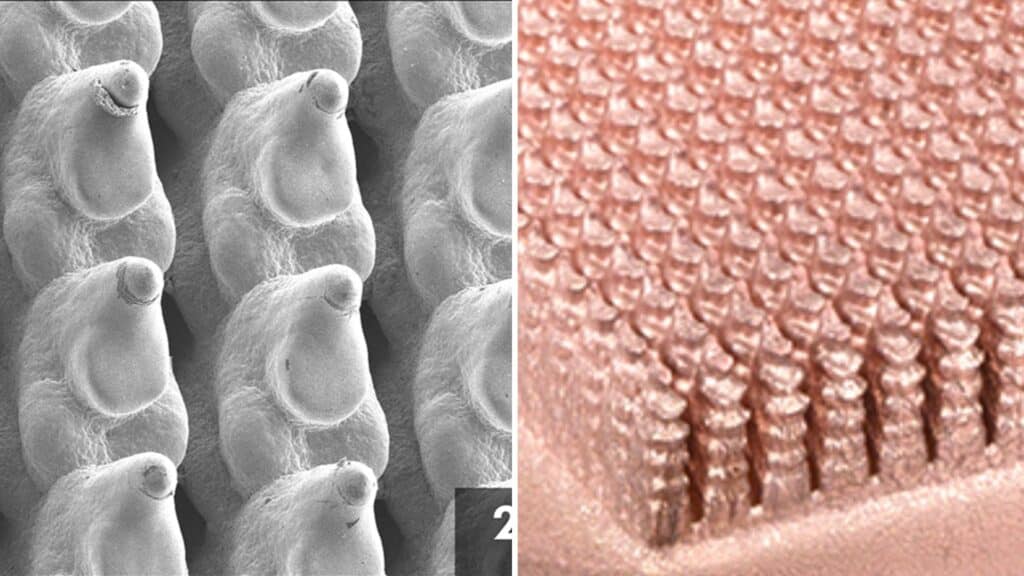

Il primo passaggio è computazionale. Behnood Bazmi, primo autore dello studio, e il senior author Nenad Miljkovic hanno usato una tecnica chiamata topology optimization: parti da un’aletta rettangolare standard, e lasci che un algoritmo la deformi iterativamente, valutando ogni variante su due parametri (quanta superficie scambia calore e quanta energia ci vuole per pompare il liquido attraverso). L’algoritmo converge verso forme che nessun ingegnere disegnerebbe a mano: alette appuntite, bordi frastagliati, geometrie irregolari che massimizzano lo scambio termico minimizzando la resistenza al flusso. Il problema è che queste forme, in officina, non si fabbricano. Sono troppo sottili (alcune più di un capello umano) e troppo complesse per la fresatura tradizionale. Come si fa, allora? Presto detto.

Stampa 3D, ma con rame puro

Un’azienda di San Diego chiamata Fabric8Labs ha sviluppato una tecnica chiamata Electrochemical Additive Manufacturing (ECAM). Non è la classica stampa metallica in 3D: invece di fondere polvere metallica con un laser, l’ECAM deposita il rame strato per strato attraverso un processo elettrochimico, lo stesso principio della galvanica ma con risoluzione micrometrica. Risultato: usando rame puro al 99 e qualcosa si possono stampare dettagli fino a 30 micrometri (quattro volte più sottili di un capello), con una conduttività termica che le leghe di alluminio (l’AlSiMg dei cold plate commerciali) si sognano.

Il numero che vale la pena ricordare arriva qui: nei test, le piastrine di rame ottimizzate raffreddano il 32% meglio dei materiali standard, e dimezzano abbondantemente l’energia per pompare il liquido (-68%). Tradotto in scala da data center: per raffreddare quel gigawatt di prima, ne servirebbero 11 megawatt invece di 550. Una svolta totale.

Scheda Studio

Pubblicazione: Bazmi, Miljkovic et al., “Ultra-high-performance cold plate development through topology optimization and electrochemical additive manufacturing”, pubblicato su Cell Reports Physical Science (2026). DOI: 10.1016/j.xcrp.2026.103272.

Il pezzo che il comunicato non racconta

I numeri sono veri, lo studio è solido, e il principio funziona. Resta una questione che non vedo affrontata nelle note che mi hanno inviato: quanto costa fabbricare un’aletta in rame puro con ECAM, oggi, rispetto a una di alluminio fuso? L’ECAM è una tecnologia giovane, finora usata per microelettronica di nicchia. Scalarla a milioni di unità per i giganti del cloud è un esercizio diverso. E il rame puro non è esattamente quello che si può riciclare da una grondaia: è una commodity con prezzi volatili e supply chain fragili, già stressata dalla domanda per i veicoli elettrici e l’infrastruttura digitale che cresce a vista d’occhio.

Da considerare anche un dettaglio operativo: queste alette funzionano sul liquid cooling, non sull’aria. Convertire un data center esistente significa rifare l’idraulica, non sostituire un ventilatore: cambia proprio il piano economico.

Quando lo vedremo davvero

Orizzonte stimato: 4-8 anni per i primi data center con questo sistema, oltre 10 per il resto del mercato.

Servono tre cose: scalare la produzione ECAM oltre la nicchia, costruire (o convertire) data center pensati per il liquid cooling, e aspettare che il prezzo del rame stampato scenda abbastanza da reggere il confronto con l’alluminio.

I primi a beneficiarne saranno i grandi del cloud che già stanno passando al liquido per via dei chip AI: Google, Amazon, Microsoft, NVIDIA. Le sale server universitarie, i data center medi, le aziende che oggi raffreddano ad aria? Aspetteranno il loro turno. Chi possiede oggi un’infrastruttura cloud distribuita guarda a queste tecnologie con interesse misto, perché la riconversione al momento costa quasi quanto il risparmio prodotto.

Se davvero riusciamo a tagliare 539 megawatt di consumo per ogni gigawatt di data center, useremo quel risparmio per ridurre l’impatto, o per metterci dentro più chip? La storia dell’efficienza energetica suggerisce la seconda. Si chiama paradosso di Jevons, ed è il motivo per cui le auto fanno il triplo dei chilometri con un litro rispetto a cinquant’anni fa, e ne consumiamo comunque di più.

Perché, vedete, il rame stampato funziona: cosa ci mettiamo dentro, è un problema diverso.