Dicembre 2022: nel laboratorio dell’Università della California a Santa Barbara tutto è silenzioso, poi c’è un flash laser e qualcosa si muove sul display. Non è solo un’immagine a cambiare su uno schermo touch, ma la superficie stessa: un pixel si solleva di un millimetro, formando un rigonfiamento percettibile al tatto.

Max Linnander ci mette un dito sopra. Sente il bump. Toglie il dito. Aspetta. Il laser lampeggia di nuovo. Il pixel si solleva ancora. Stessa altezza, stessa precisione. Quello che sembrava impossibile funziona davvero: trasformare la luce in qualcosa che si può toccare.

Tre anni dopo, il team guidato dal professor Yon Visell ha appena pubblicato su Science Robotics i risultati dello sviluppo di una tecnologia che ridefinisce cosa può fare uno schermo touch. Non si tratta di vibrazioni o feedback aptico tradizionale. Qui i display generano vere e proprie forme tridimensionali che puoi vedere e toccare contemporaneamente. Li chiamano Pixel optotattili: funzionano senza cavi, senza elettronica integrata, solo con la luce proiettata da un laser a bassa potenza.

Come funzionano i pixel che si sollevano

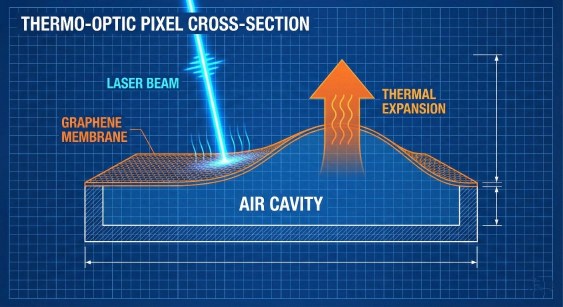

Ogni pixel è una cavità microscopica riempita d’aria, sigillata da una membrana di grafite sottilissima. Il laser colpisce la grafite. La grafite assorbe la luce e si scalda rapidamente. L’aria dentro la cavità si espande per effetto del calore. La membrana si gonfia verso l’alto, creando un rigonfiamento fino a un millimetro di altezza. Tutto questo avviene in 2-100 millisecondi.

Il laser non resta fisso. Si muove ad alta velocità sulla superficie dello schermo touch, illuminando ogni pixel per una frazione di secondo secondo uno schema prestabilito. Il ritmo è abbastanza rapido da rendere le animazioni fluide, come nei normali schermi video. Solo che qui, oltre a vedere il movimento, lo puoi sentire scorrere sotto le dita.

I prototipi dimostrati dai ricercatori californiani contano 1.511 pixel indipendenti, molto più di qualsiasi display tattile comparabile sviluppato finora. La risoluzione è millimetrica: nei test percettivi, i partecipanti hanno localizzato i pixel attivati con una precisione media di 0,17 millimetri e un’accuratezza del 78,4%.

Schermo touch “optotattile”: 3 anni per far funzionare un’idea impossibile

La domanda che Visell aveva posto a Linnander nel settembre 2021 era apparentemente semplice: si può convertire la luce che forma un’immagine in qualcosa di tangibile? La risposta iniziale fu un’ammissione di incertezza. “Non sapevamo se fosse fattibile”, ha raccontato Visell. L’idea stessa di far ‘sentire la luce’ rendeva la sfida irresistibile, anche se il rischio di fallimento era concreto.

Seguirono mesi di simulazioni al computer e modellazione teorica. Linnander testava varianti, calibrava parametri termodinamici, cercava la configurazione giusta per far funzionare il principio fisico alla base dei pixel. Niente. Poi arriva dicembre 2022. Un singolo pixel, un diodo laser, nessun componente elettronico. Visell mette il dito sul prototipo. Sente una pulsazione tattile sincronizzata con il flash di luce. E quello è il momento in cui capiscono che l’idea regge.

I principi fisici dietro al tocco luminoso

Il meccanismo non è completamente nuovo. Nel XIX secolo, Alexander Graham Bell usava luce solare concentrata, modulata dalle pale di una ventola rotante, per generare suoni in provette piene d’aria. Lo stesso principio termodinamico (luce assorbita che riscalda un gas in espansione) è oggi applicato ai pixel optotattili. La differenza è nell’implementazione: qui non genera suono ma spostamento meccanico visibile e percepibile.

Il team californiano ha studiato anche la percezione umana di questi stimoli. Nei test, i partecipanti hanno discriminato correttamente pattern temporali (sequenze di impulsi veloci o lenti) nell’89,6% dei casi. Quando dovevano identificare quale coppia di dita veniva stimolata simultaneamente su quattro possibili, l’accuratezza è salita al 96,3%. Il sistema funziona, e il cervello lo interpreta senza difficoltà.

Applicazioni concrete (e qualche paradosso)

Visell immagina schermi touch automobilistici che emulano controlli fisici senza esserlo, libri elettronici con illustrazioni tattili che prendono forma sulla pagina, superfici architettoniche intelligenti per ambienti di realtà mista. La scalabilità della tecnologia è un vantaggio: usando proiettori laser video moderni, si potrebbero costruire display di grandi dimensioni con migliaia di pixel.

Il paradosso? Stiamo cercando di rendere gli schermi più “reali” aggiungendo il tatto, dopo aver passato decenni a dematerializzare tutto. Come vi raccontavo già nel 2021, l’obiettivo delle interfacce aptiche è arricchire l’interazione uomo-macchina alleggerendo il carico cognitivo sostenuto da vista e udito. Ma serve davvero sentire la texture di una camicia prima di comprarla online? O è solo un modo più sofisticato per venderci cose di cui non abbiamo bisogno? Borbotto.

Scheda dello Studio

- Ente di ricerca: University of California, Santa Barbara (RE Touch Lab)

- Anno: 2024-2025

- DOI: 10.1126/scirobotics.adv1383

- TRL: 4-5 – Componente validato in laboratorio, primi prototipi funzionali dimostrati

La tecnologia aptica non è una novità (ma questa sì)

I display aptici esistono da anni. Sistemi piezoelettrici, pneumatici, elettromagnetici: ciascuno con i suoi limiti in termini di velocità, risoluzione o scalabilità. La maggior parte richiede elettronica integrata, cablaggio complesso, consumi energetici elevati. I pixel optotattili dell’Università della California, come detto, eliminano questi vincoli usando la luce come vettore di energia e di indirizzamento. Niente fili. Niente circuiti stampati nel display. Solo superfici passive che reagiscono alla luce proiettata.

L’aspetto interessante di questo schermo touch (mi rendo conto che la parola “touch” assume un altro significato) è la velocità di risposta. Con tempi di reazione compresi tra 2 e 100 millisecondi, il sistema può generare animazioni tattili continue, non solo pattern statici. Questo apre scenari che vanno oltre i semplici “bump” sulla superficie: sequenze dinamiche, forme che cambiano in tempo reale, feedback aptico sincronizzato con contenuti visivi.

Quando e come ci cambierà la vita

La tecnologia è ancora in fase di ricerca avanzata, ma i ricercatori stimano applicazioni commerciali entro 5-7 anni. I primi dispositivi potrebbero apparire nelle interfacce automobilistiche di fascia alta, dove gli schermi touch sostituiscono i controlli fisici creando problemi di sicurezza (distrazione visiva).

Display aptici permetterebbero ai conducenti di “sentire” i pulsanti senza guardare lo schermo. Più avanti: device medicali per persone con disabilità visive, interfacce educative tattili, controller per realtà virtuale.

Approfondisci

Ti interessa il futuro delle interfacce uomo-macchina? Leggi anche come gli schermi tattili stanno evolvendo verso il feedback aptico multisensoriale. Oppure scopri come i touchscreen spruzzabili potrebbero rendere interattivo qualsiasi oggetto.

La domanda rimane: sentire quello che vedi su uno schermo è un progresso tecnologico o un modo più elaborato per riempire un vuoto che non sapevamo di avere? I pixel optotattili funzionano. Ma serve davvero toccare la luce, o ci basta continuare a guardarla?