L’AI ha veri e propri ‘superpoteri’ potenzialmente molto pericolosi per il futuro degli esseri umani (e più di un esperto sta provando a metterci in guardia).

I sistemi di intelligenza artificiale sono ormai noti per la loro capacità strategica e vengono sempre più usati in contesti reali. Hanno esteso la loro portata al punto che gli umani stanno ora intenzionalmente abusando, maltrattando e abusando di loro. Il potenziale intrinseco delle attuali tecnologie AI sta crescendo man mano che vengono incorporate nell’infrastruttura sociale, e questo è un altro segno che le conseguenze della perdita del suo controllo sarebbero gravissime.

Ci sono numerose situazioni in cui i pericoli derivanti dall’AI dovrebbero essere discussi, così come le sue conseguenze future che vanno previste e gestite. Eccovi 10 superpoteri che potrebbero farci molto, molto male.

Perdita di posti di lavoro

Questo è l’argomento principe di tutti quelli che sono prudenti riguardo all’intelligenza artificiale (anche di quelli che vanno inutilmente nel panico). Questo problema non riguarda il fatto che l’intelligenza artificiale si impadronirà o meno di particolari professioni, ma quanto influirà sull’occupazione umana.

Si prevede che l’automazione del lavoro si tradurrà in un alto numero di professionisti disoccupati che non sono di natura high-tech. Man mano che i robot AI diventano più intelligenti, le stesse attività richiederanno meno lavoratori umani. Come evitarlo? Dare una morale all’AI? Non so se si può. Come riconfigurare il lavoro umano? Ci sono tanti modi, dall’accento su professioni creative e umanistiche a formule come il reddito universale.

Crescita della disuguaglianza socioeconomica

Diretta conseguenza del primo dei ‘superpoteri’ descritti è la crescente disparità economica causata dalla perdita di posti di lavoro indotta dall’AI. Per ora, solo le attività predittive e ripetitive sono attualmente suscettibili di acquisizione da parte dell’intelligenza artificiale, ma studi e indagini hanno previsto che i criteri potrebbero espandersi in futuro. Di conseguenza, i lavoratori scarsamente qualificati avranno sempre meno opportunità di riqualificarsi, gli altri dovrebbero cavarsela. Un pericolo enorme.

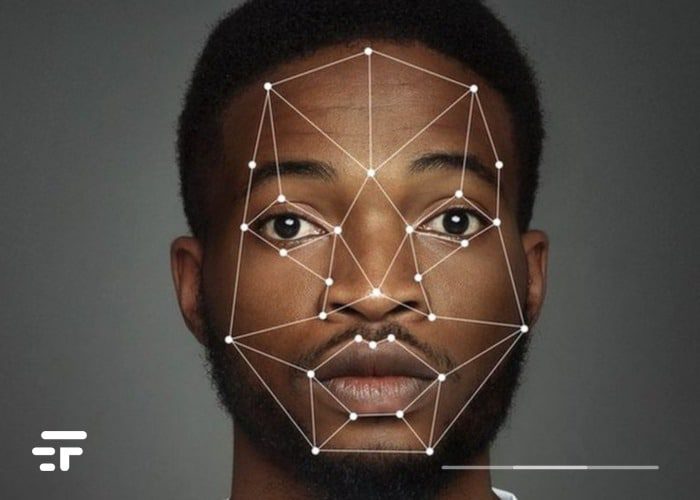

Violazione della privacy

Con l’AI sempre più integrata in tanti dei più importanti servizi tecnologici, è diventato semplice monitorare, confrontare e analizzare le attività di un individuo online e offline. Telecamere e Big Data stanno per entrare in un rapporto tale da “dialogare” costantemente tra loro. Se aggiungete le moderne, sofisticate tecnologie di riconoscimento dei volti, capirete che i tracker sapranno esattamente dove ci troviamo e cosa stiamo facendo, praticamente in tempo reale. Più che superpoteri, parlerei di onniscenza.

Armi autonome

I robot assassini, conosciuti anche come armi autonome o “killer bot”, sono robot militari che possono cercare e distruggere i loro obiettivi in modo indipendente secondo istruzioni preprogrammate. Quasi ogni nazione tecnologicamente avanzata del pianeta sta sviluppando macchine da guerra autonome che prenderanno il posto dei soldati umani. Inutile dire che ci sono diversi problemi enormi legati all’utilizzo di queste macchine. La questione più critica è: chi sarà ritenuto responsabile per questi robot artificialmente intelligenti che vanno fuori controllo e commettono atti terribili che possono comportare la perdita di vite umane?

Deepfake

I deepfake sono perfetti per essere usati da persone malevole e criminali per creare confusione, paura o disgusto. Possono contribuire a diffondere disinformazione, costruire false narrazioni sugli individui, e anche generare un’immagine pubblica specifica del soggetto che può danneggiare qualcuno fisicamente e psicologicamente. Da poco sono stati impiegati per la prima volta in un teatro di guerra (si, proprio come un’arma).

Terrorismo AI

I superpoteri AI (diamo a Cesare quel che è di Cesare) possono aiutare la sicurezza nazionale di un paese in numerosi modi, ma possono anche aiutare i malintenzionati a portare a termine assalti terroristici. I droni sono utilizzati da diverse organizzazioni terroristiche per effettuare attacchi e osservare le attività militari oltre i confini. Abbiamo visto mezzi del genere impiegati già in azioni, e non è lontano il giorno in cui vedremo migliaia di droni killer impiegati in un solo colpo.

Manipolazione sui social media

La manipolazione dei social media può essere abbastanza efficiente nel marketing, ed è sempre più facile essere influenzati da algoritmi autonomi. L’AI può indirizzare e distribuire qualsiasi informazione che si vuole trasmettere senza alcun input o filtro da parte dell’utente, purché la propaganda sia condivisa con gruppi mirati di persone tramite algoritmi e dati personali.

AI Sovrumana: il Re dei Superpoteri

Entrate (ma sappiate anche uscirne) in una logica di ipotesi. È possibile, come detto, che tra qualche anno la diffusione di robot programmati per uccidere “nemici” siano hackerati o assumano un controllo che sfugge a quello degli esseri umani?

Ecco: questo è lo scenario peggiore in assoluto. Attualmente, i sistemi di AI sovrumani sono una specie di mito, ma per quanto tempo rimarranno un mito?

Pregiudizi dell’AI

La religione, il sesso e la nazionalità sono tutte cose su cui la gente continua a litigare e fare guerre anche oggi, nel ventunesimo secolo. È una cosa terribile, lo vediamo tutti i giorni. Questo pregiudizio può anche riflettersi nei sistemi di AI come conseguenza di dati errati forniti dalle persone. Per sbarazzarsi di questo problema, gli scienziati informatici devono cancellare manualmente ogni informazione irrilevante. Non è facile, specie se considerate che già adesso un’intelligenza artificiale scambia persone per scimmie.

Destabilizzare il mercato azionario

Negli ultimi anni, gli esperti hanno espresso la preoccupazione che l’avvento del trading algoritmico possa provocare una catastrofe finanziaria. Il trading algoritmico è costituito da transazioni ad alta frequenza e di alto valore che possono causare una significativa volatilità del mercato. Questo tipo di trading ignora la logica e i sentimenti umani, eppure rimane una componente essenziale dei mercati finanziari. Ancora una volta: chi sarà ritenuto responsabile se una intelligenza artificiale provocherà una nuova crisi del ’29?